# 도로를 달리던 자율주행차 앞으로 갑자기 차가 끼어들면서 충돌 직전의 상황에 몰렸다. 그대로 직진하면 앞 차량의 운전자가 다치고 오른쪽으로 핸들을 꺾으면 4명의 행인이 다친다. 자율주행차 알고리즘은 사고에 대해 어떤 책임을 져야 할까?

# 인공지능(AI) 의료 서비스 ‘왓슨’의 오진으로 환자가 사망했다. 왓슨 또는 왓슨을 설계한 IBM, 왓슨을 구매한 병원, 왓슨과 협진한 의사 중 누가 책임을 지게 될까?

# 2015년 2월. 네덜란드에서 트위터 ‘봇(Bot)’ 계정이 살인을 예고하는 문장을 트윗했다. 이 문장은 ‘봇’이 주인의 트윗에서 단어를 무작위로 뽑아내 만든 것이었다. 결국 경찰은 봇 계정 소유자에게 경고하고 봇 계정을 삭제하는 것으로 사건을 마무리했다.

인공지능(AI)을 탑재한 로봇이 스스로 학습하고 판단하는 시대가 열리면서 책임 소재를 둘러싼 논란이 뜨겁다. 사람을 대신할 똑똑한 AI와 힘센 로봇을 통해 인간의 삶이 보다 편안해지고 윤택해질 것으로 기대하지만 현실의 상황은 마냥 낙관적이지 않다. AI와 로봇이 운전하고 수술하는 시대가 가까워지면서 오작동과 판단착오 등 각종 사고에 대한 책임을 누가 질 것인지에 대한 논란은 갈수록 커질 수 밖에 없다.

전문가들은 “우리나라도 기술 선진국처럼 로봇 규제와 법제도 마련을 위한 논의를 서둘러야 한다”고 강조한다. ‘AI가 인류의 존재까지 위협한다’며 정부의 적극적인 개입과 강력한 법제화를 요구하는 입장과 ‘AI가 가져올 긍정적 변화들을 위해 규제는 최소로 해야 한다’는 주장이 맞설 수밖에 없는 상황에서 공개적 토론을 통해 사회적 합의점을 찾는 작업이 필요하다. 피터 아사로 프린스턴대 교수도 “로봇은 파괴적 혁신 기술이기 때문에 기존의 법과 정책으로 규제할 수 없다”며 “다양한 분야의 전문가들이 로봇과 AI를 위한 법률과 정책에 대해 논의하고 사회적 합의를 만들어야 한다”고 지적했다. 로봇 규제는 로봇이 아닌 인간이 결정해야 하는 것으로 인류의 미래를 어떻게 설계하고 그려갈 것인지에 대한 공감대가 있어야 한다.

실제로 기술 선진국인 미국과 유럽은 발 빠르게 로봇과 AI 규제 마련에 나섰다. ‘인간이 인간을 위해 만든 로봇이 결국에는 인간을 위협한다’는 ‘로봇 디스토피아’의 경고를 무시하기 힘든 조짐들이 여기저기서 나타나면서 속도가 붙었다.

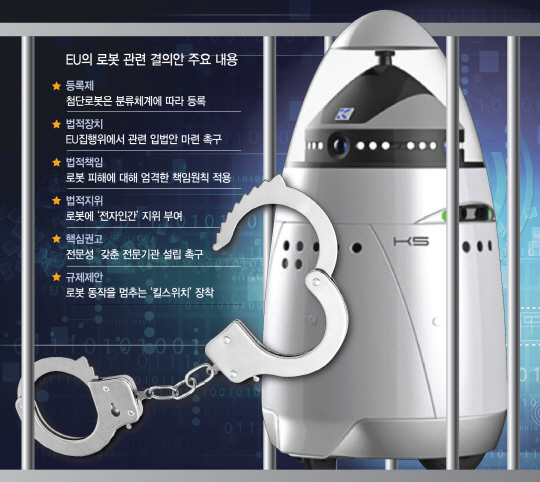

유럽연합(EU)은 지난 2월 로봇 관련 결의안에 합의했다. 로봇이 초래한 피해에 대해 엄격한 책임원칙을 적용하기로 했다. 이를 위해 로봇에 전자 인간의 법적 지위를 부여하고 로봇이 잘못해서 발생한 손해 보상과 로봇이 자율적으로 결정한 사건 등에 대해 책임을 부여할 수 있게 했다. 또 로봇을 제작할 때 ‘킬 스위치’를 장착해 제안했다. 설계자가 오작동 로봇을 직접 멈출 수 있어야 한다는 것이다.

미국도 AI 기술의 최우선 과제로 공익 보호와 공정성, 책임성, 투명성 확보를 내세우고 지속적인 모니터링을 통해 올바른 방향으로 기술개발이 진행될 수 있도록 가이드 하기로 했다. 또 ‘삶의 미래 연구소’는 지난 1월 ‘아실로마의 AI 23원칙’을 제시했다. 연구 관련 쟁점, 윤리와 가치, 장기적 이슈 등 세 가지 범주에 대한 원칙을 세우고 ‘인간에게 유용한 지능을 개발해야 한다’고 강조했다.

우리나라도 로봇 수술과 AI 진단을 시행하는 의료계를 중심으로 관련 제도와 규정 마련을 위한 논의가 시작됐다. 4월 말 대통령 소속 국가생명윤리심의위원회는 ‘인공지능(AI)의 의료적 활용과 생명윤리’ 포럼을 열고 제도 개선을 위한 첫발을 내디뎠다. 이 자리에 참석한 토론자들은 이구동성으로 사회적 공감대를 통한 제도 마련의 시급함을 역설했다. 윤혜선 한양대 법학전문대학원 교수는 “AI를 이용한 의료행위가 이뤄지고 있는 현실에서 관련 법규의 정비를 서둘러야 한다”며 “AI가 적용된 새로운 의료기술이나 기기에 대한 명확한 정의와 인증·허가제도가 필요하다”고 강조했다. 특히 “AI 기술 개발과 이용에 핵심 자원인 데이터의 확보와 처리·보안, 개인정보·사생활 보호, 의료 사고나 오작동에 의한 피해 책임 등도 신속히 해결해야 할 과제”라고 덧붙였다.

또 AI의 진단 오류에 대해 AI가 책임을 져야 한다는 주장도 나왔다. 이중원 서울시립대 철학과 교수는 “로봇 의사 왓슨과 인간 의사는 일종의 다중 행위자로 인간에게만 도덕적 책임을 물을 수는 없다”며 “AI에도 의학적 오판에 대한 책무 개념을 적용할 필요가 있다”고 지적했다.