오픈AI가 기업 전용 챗GPT 구독 모델을 내놓는다. 기업들 사이에서 챗GPT를 사용할 때 회사 기밀이 유출될 수 있다는 우려가 제기되고 있어, 이에 대한 대응책으로 분석된다. 다만 챗GPT의 기능을 고도화 할 머신러닝용 데이터 확보가 다소 어려워질 수 있는 만큼 인공지능(AI) 서비스 고도화도 그만큼 느려질 수 있다는 우려가 제기된다.

오픈AI는 25일(현지시간) 기업향 구독 모델인 ‘챗GPT 비즈니스’를 개발 중이라고 밝혔다. 올 2월 초 월 20달러의 구독 모델 ‘챗GPT 플러스’를 내놓은 지 약 3개월 만이다.

이번 챗GPT 비즈니스는 직원들의 데이터 활용에 대한 통제나 제어가 필요한 기업을 타깃 고객군으로 한다. 챗GPT 비즈니스 사용자가 챗GPT에 입력하는 데이터의 경우 머신러닝에 사용되지 않는다는 점이 기존 모델과의 가장 큰 차이점이다. 비즈니스 모델은 수개월 내 정식 출시될 예정이다.

챗GPT의 이 같은 사업모델 출시는 챗GPT 이용 기업의 영업비밀 유출 우려를 없애지 않으면 챗GPT 생태계가 제대로 확산 될 수 없다는 판단 때문으로 분석된다.

실제 일부 기업들은 대화형 AI 서비스와 관련된 업무 가이드라인이 준비되지 않은 상황에서 섣불리 이를 도입했다 기밀 유출 등으로 곤욕을 치른 바 있다.

삼성전자가 대표적이다. 삼성전자 디바이스솔루션(DS) 사업부는 지난달 사내 챗GPT 사용을 허용한 후 얼마 되지 않아 정보 유츨 사태를 겪었다. 당시 삼성전자 직원은 반도체 설비 계측 데이터베이스 관련 소스 코드 내 오류를 수정하기 위해 소스코드를 챗GPT 입력창에 붙여 넣었다가 정보 유출 우려로 제재를 받았다. 실제 챗GPT에 입력한 데이터는 오픈AI가 서비스를 고도화하는데 사용된다. 오픈AI도 이 때문에 민감한 정보는 입력하지 말라고 권고하고 있다.

이와 관련해 삼성전자 DS 부문은 최근 챗GPT 오남용에 대해 주의를 당부하는 메시지를 전 직원에 공지하는 한편 팀원 대상의 챗GPT 사용 가능 범위 등에 대한 교육을 진행하기도 했다.

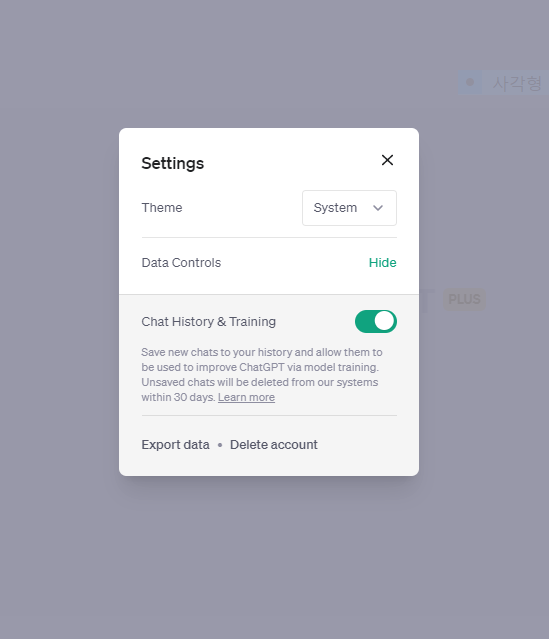

오픈AI는 기업뿐만 아니라 개별 개인 사용자 또한 이들의 데이터 통제권을 강화할 수 있게 했다. 오픈AI는 개인정보에 민감한 개별 사용자를 위해 채팅 기록 비활성화 장치를 도입했다. 설정 페이지에서 채팅 기록을 비활성화하는 버튼을 누르면, 오픈AI는 사용자 데이터를 저장하지 않으며 모델 학습을 위해 사용하지도 않는다. 다만 향후 사용자의 대화가 문제를 일으킬 경우에 대비해 관련 데이터를 30일간 보관하기로 했다. 오픈AI는 또 챗GPT를 통해 나눈 대화 내역을 담은 파일을 이메일로 쉽게 받아볼 수 있게하는 기능도 추가했다.